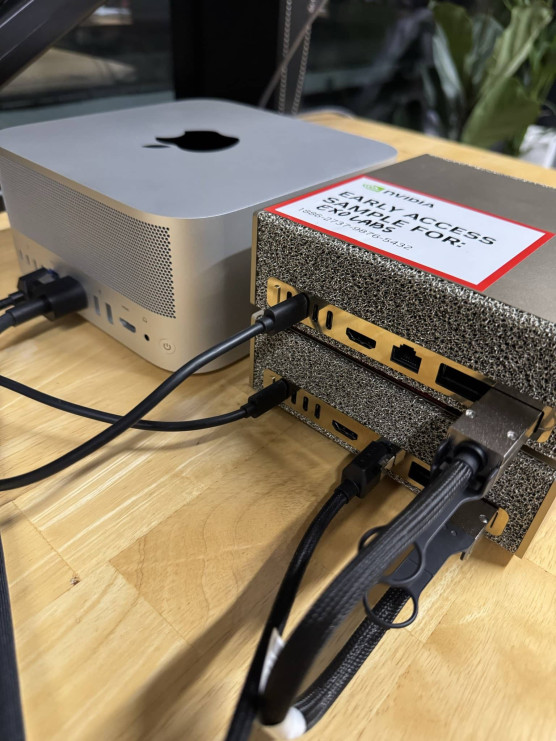

EXO объединила два DGX Spark и Mac Studio для ускоренного вывода больших языковых моделей

Компания EXO Labs представила EXO 1.0 — открытую платформу для запуска больших языковых моделей (LLM) на разнородной вычислительной технике, включая десктопы, серверы и даже смартфоны. Новый демо-проект продемонстрировал, как две станции NVIDIA DGX Spark могут работать в паре с Apple Mac Studio на чипе M3 Ultra, формируя единое решение для ускоренного вывода моделей. Вместо монолитного подхода EXO реализует дизагрегированный вывод, распределяя различные этапы обработки между системами — предварительный анализ (prefill) поручается GPU-системе, а генерация токенов (decode) — высокоскоростному чипу Apple.

В системе использовалась 10-гигабитная сеть Ethernet для потоковой передачи данных KV-кэша, что позволило одновременно задействовать оба устройства без простоев. Концепция базируется на различии в характере нагрузки: этап prefill требует высокой вычислительной мощности, в чём хорош DGX Spark с 100 TFLOPS (fp16), а decode — зависим от пропускной способности памяти, где M3 Ultra с 819 ГБ/с выигрывает. В тесте на модели Llama 3.1 8B гибридная система достигла почти троекратного ускорения по сравнению с Mac Studio, при этом обеспечив производительность на уровне Spark в prefill и рекордное время генерации на этапе decode.

EXO Labs продвигает идею гибкого масштабирования ИИ без необходимости в дорогостоящем едином ускорителе. Подобную архитектуру уже начинает развивать NVIDIA в рамках платформы Rubin CPX, где разные чипы обрабатывают prefill и decode раздельно. Но EXO делает это уже сейчас — на открытом ПО и потребительском «железе». Пока версия 1.0 доступна только по приглашениям, но это первый шаг к миру, где ИИ может использовать любую технику — эффективно и масштабируемо.