Nvidia уничтожает конкурентов в MLPerf: Blackwell Ultra в 5 раз быстрее Hopper

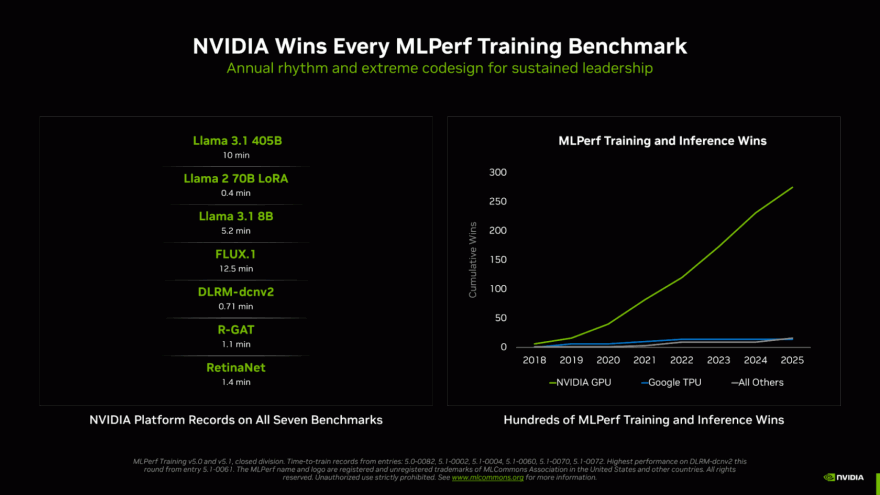

NVIDIA в очередной раз подтвердила свое абсолютное доминирование в индустрии искусственного интеллекта, "уничтожив" всех конкурентов в последнем раунде MLPerf Training v5.1. Это стандартный отраслевой тест, измеряющий скорость обучения ИИ-моделей. NVIDIA "выиграла во всех семи тестах" и стала единственной компанией, которая вообще смогла предоставить результаты по всем дисциплинам, включая новые Llama 3.1 8B и FLUX.1.

Главным событием раунда стал дебют стоечной системы GB300 NVL72 на базе архитектуры Blackwell Ultra. Результаты ошеломляют: по сравнению с предыдущим поколением (Hopper), система Blackwell Ultra показала более чем 4-кратный прирост в предварительном обучении Llama 3.1 405B и почти 5-кратный прирост в тонкой настройке Llama 2 70B (при одинаковом количестве GPU).

Этот скачок стал возможен благодаря архитектурным улучшениям и новому формату NVFP4. Blackwell Ultra может выполнять вычисления в FP4 в 3 раза быстрее, чем FP8, обеспечивая колоссальную производительность. NVIDIA — единственная компания, которая смогла отправить результаты в MLPerf, используя FP4, и при этом сохранить требуемую точность.

NVIDIA также установила новый рекорд, обучив гигантскую модель Llama 3.1 405B всего за 10 минут, используя кластер из более чем 5000 GPU Blackwell. На графике "совокупных побед" (Cumulative Wins) видно, что с 2018 года NVIDIA (зеленая линия) ушла в космос, в то время как Google TPU (синяя линия) и "Все остальные" (серая) остались далеко позади, практически на нуле.